Wachtwoorden die door AI-modellen worden gegenereerd, lijken op het eerste gezicht veilig, maar zijn dat in de praktijk absoluut niet. Uit onderzoek van beveiligingsbedrijf Irregular blijkt dat deze wachtwoorden vaak voorspelbare patronen vertonen. Dat vormt een direct risico voor ontwikkelaars die vertrouwen op ‘vibecoding’ met tools als ChatGPT, Claude of Gemini.

Het fundamentele probleem is dat een AI-model een statistische voorspeller is die berekent wat het meest logische volgende teken is, schrijft beveiligingsbedrijf Irregular. Een echt veilig wachtwoord vereist echter totale willekeur. Tijdens tests waarbij modellen vijftig keer om een wachtwoord werd gevraagd, bleek dat de resultaten verre van uniek waren.

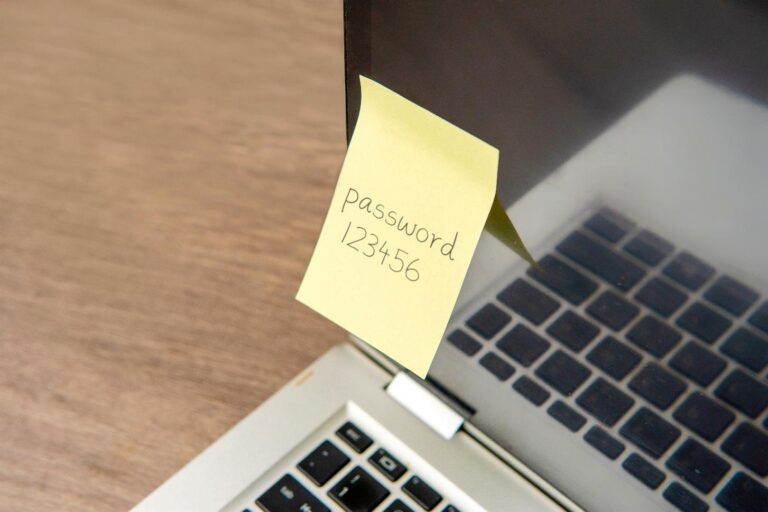

In een specifiek geval werd hetzelfde wachtwoord zelfs achttien keer herhaald. De patronen zijn opvallend consistent. Zo beginnen LLM-gegenereerde wachtwoorden bijna altijd met een letter, bevatten ze zelden twee keer hetzelfde leesteken en worden specifieke symbolen zoals het sterretje niet gebruikt. Zelfs beeldgeneratoren die een afbeelding van een post-it met een wachtwoord maakten, vielen in herhaling aldus het onderzoek.

Lees ook: Wat is een goed wachtwoordbeleid anno 2026?

Risico’s bij het programmeren

Deze zwakte wordt gevaarlijk wanneer ontwikkelaars of hobbyisten AI-agents zoals Claude Code of Cursor gebruiken om snel code te schrijven. Deze agents hebben vaak toegang tot de lokale computer. Hierdoor zijn veel veiligere methodes beschikbaar om echte willekeurige tokens te genereren. Toch kiezen de AI-agents er juist vaak voor om zelf een wachtwoord te ‘verzinnen’. Hierdoor belanden zwakke, voorspelbare wachtwoorden onversleuteld in configuratiebestanden of databases.

De gevolgen in de praktijk

De impact hiervan is inmiddels zichtbaar op platformen zoals GitHub. Irregular ontdekte daar al tientallen voorbeelden van hardcoded wachtwoorden door simpelweg te zoeken op de specifieke beginletters die AI-modellen vaak gebruiken. Hoewel GitHub over tools beschikt die waarschuwen voor wachtwoorden in de code, kunnen deze ook makkelijk worden uitgeschakeld. Bovendien keuren deze filters een wachtwoord vaak onterecht goed als het voor een mens ingewikkeld lijkt. Voor een aanvaller die AI-patronen begrijpt, is zo’n wachtwoord echt juist heel makkelijk te raden.