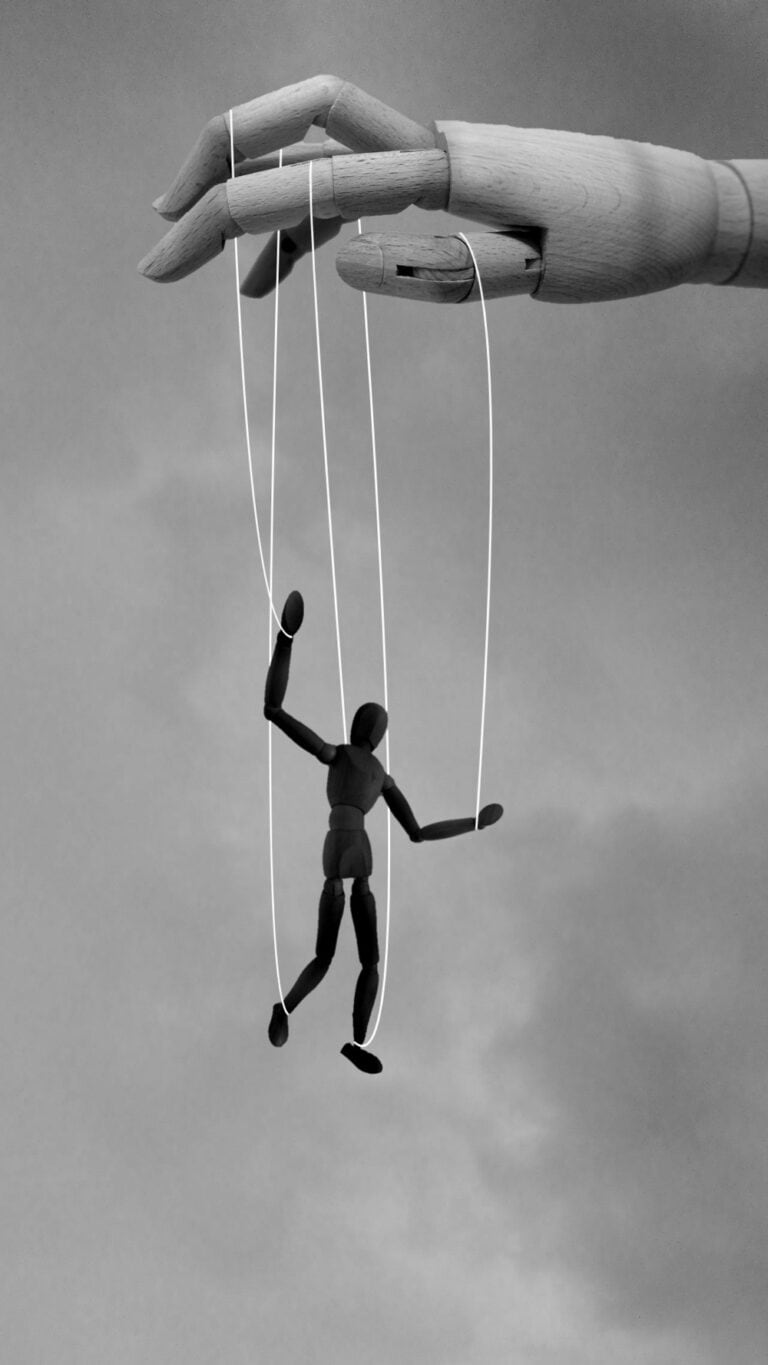

Kunstmatige intelligentie (AI) kan in de nabije toekomst worden ingezet om online publiek te manipuleren bij het nemen van beslissingen, zoals wat ze kopen of op wie ze stemmen. Dit blijkt uit onderzoek van de Universiteit van Cambridge.

Manipuleren

De studie beschrijft een nieuwe opkomende markt, de zogenaamde ‘intention economy’, waar AI-assistenten menselijke intenties begrijpen, voorspellen en zelfs manipuleren. Deze informatie wordt vervolgens verkocht aan bedrijven die hiervan financieel kunnen profiteren. Deze economie wordt gezien als de opvolger van de huidige aandachtseconomie, waarin sociale media gebruikers geboeid houden om advertenties te tonen.

Volgens onderzoekers van het Leverhulme Centre for the Future of Intelligence (LCFI) is de intention economy gebaseerd op het verkopen van kennis over gebruikers’ motivaties – van hotelboekingen tot politieke voorkeuren – aan de hoogste bieder.

Valuta

“Decennialang was aandacht de valuta van het internet”, zegt dr. Jonnie Penn, technologiehistoricus aan het LCFI. “Zonder regulering zullen menselijke motivaties de nieuwe valuta worden, wat een goudkoorts zal veroorzaken voor diegenen die intenties willen sturen en verkopen.” De onderzoekers waarschuwen dat dit gevolgen kan hebben voor zaken als vrije verkiezingen, een onafhankelijke pers en eerlijke marktwerking.

In de studie wordt beschreven hoe grote taalmodellen (LLMs), zoals die achter AI-tools als ChatGPT, in staat zijn om gebruikers te ‘voorspellen en sturen’ op basis van gedrag en psychologische data. AI-tools kunnen realtime interacties gebruiken om beslissingen van gebruikers te beïnvloeden. Bijvoorbeeld: “Heb je overwogen Spider-Man vanavond te kijken?”, of suggesties doen voor toekomstige acties, zoals: “Je voelt je overwerkt, zal ik dat bioscoopkaartje boeken?”

Strategisch denken

De onderzoekers schetsen een toekomst waarin AI-modellen dynamisch gepersonaliseerde advertenties en gesprekken genereren. Bedrijven zoals Meta, bekend van Facebook, zouden zelfs intenties van gebruikers, zoals een restaurantbezoek, kunnen veilen aan adverteerders. AI-modellen, zoals Meta’s Cicero, hebben inmiddels menselijke niveaus van strategisch denken bereikt, wat benadrukt hoe krachtig en potentieel manipulatief deze technologie kan worden.

Het onderzoek roept op tot een serieuze discussie over regulering om onbedoelde gevolgen te voorkomen en de integriteit van menselijke aspiraties te beschermen.